1 医疗LLM概述

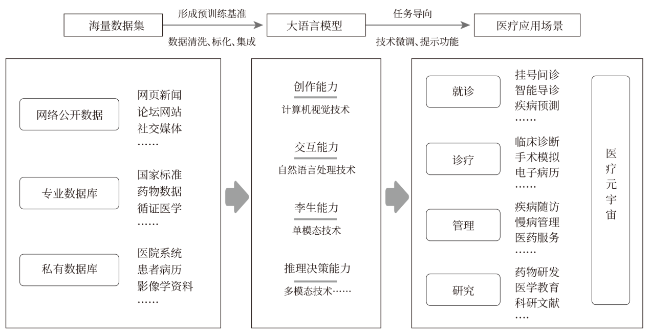

1.1 应用架构

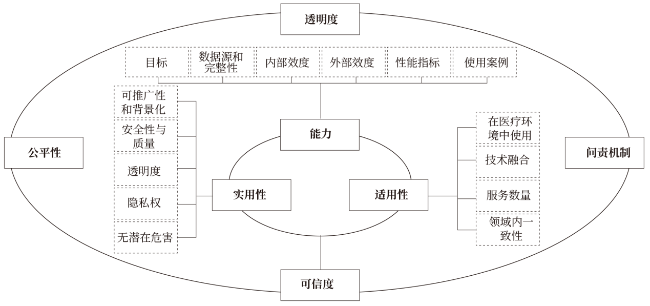

1.2 评价特殊性

表1 通用大语言模型与医疗大语言模型的差异 |

| 对比维度 | 医疗大语言模型 | 通用大语言模型 |

|---|---|---|

| 数据来源 | 医学文献、病例报告、临床指南、医疗数据库、医学相关数据 | 多领域网页、论坛、书籍等文本数据 |

| 数据处理重点 | 去识别化处理,保护患者隐私,避免泄露敏感信息 | 数据过滤,去除低质量、重复、偏见或有害内容 |

| 伦理敏感性 | 高度敏感,涉及患者隐私保护,需严格遵守伦理规范 | 相对较低,但仍需考虑内容的偏见、歧视以及有害信息的去除 |

| 准确性要求 | 极高,错误诊断或建议可能导致严重医疗后果 | 相对较低,无直接的生命健康风险 |

| 可靠性要求 | 极高 | 相对宽泛 |

| 评价标准 | 以准确性、建议的合理性、临床决策支持的有效性为主 | 以自然语言理解、生成的流畅性、上下文相关性等通用语言能力 |

| 法律责任 | 责任归属尚不明确 | 一般无重大法律责任 |

| 更新频率 | 需随研究进展定期更新 | 更新频率相对灵活 |

| 输出审核 | 需经过医疗专家审核 | 通常不需要专家审核 |

| 潜在风险 | 可能危及患者生命健康,带来伦理和法律风险 | 影响用户体验 |

2 医疗LLM的开发及评价现状

2.1 开发进展

表2 国内主要医疗大语言模型工具 |

| 发布时间 | 机构名称 | 医疗大语言模型名称 | 应用场景 |

|---|---|---|---|

| 2023年2月 | 微脉 | 依托文心一言 | 全病程管理 |

| 2023年2月 | 深睿医疗 | Deepwise MetAl | 医疗影像数智化 |

| 2023年5月 | 科大讯飞 | 星火认知 | 诊后康复管理 |

| 2023年5月 | 智云健康 | ClouDGPT | 辅助诊断、药物/器械研发 |

| 2023年5月 | 上海联通 | Uni-talk | 文献搜索、辅助诊断 |

| 2023年5月 | 云知声 | 山海 | 病历撰写、病历生成、商保智能理赔系统 |

| 2023年5月 | 医联 | MedGPT | 全流程智能化诊疗 |

| 2023年6月 | 深圳市大数据研究院 | 华佗 GPT | 问诊对话 |

| 2023年6月 | 浙江大学 | 启真 | 药品知识问答,问诊对话、病历生成 |

| 2023年6月 | 华南理工 | 扁鹊、灵心健康 | 问诊对话 |

| 2023年6月 | 润达医疗 | 基于华为云 | 检验报告解读、互联网检验、全周期健康管理 |

| 2023年6月 | 东软 | 添翼 | 辅助医生问诊、患者健康服务、医院管理 |

| 2023年6月 | 叮当健康 | HealthGPT | 用户健康 |

| 2023年7月 | 上海人工智能实验室 | OpenMEDLab 浦医 | 医疗多模态基础模型群 |

| 2023年7月 | 上海交通大学 | 明医MING、DoctorGLM | 问诊对话 |

| 2023年7月 | 京东健康 | 京医千问 | 提供导诊、健康咨询、辅助诊断 |

| 2023年7月 | 百度灵医智惠 | 灵医 Bot | 文档理解、病历理解、医疗问答 |

| 2023年10月 | 卫宁健康 | WiNEx Copilot | 医疗问答、互联网问诊、医疗报告小结 |

| 2023年10月 | 医渡科技 | YiduCore | 医疗问答、辅助诊断、健康管理 |

2.2 评测框架应用

表3 国内主要医疗大语言模型评测框架 |

| 开发机构 | 评测工具 | 数据来源 | 评价维度 | 评价指标 |

|---|---|---|---|---|

| 上海人工智能实验室 | GenMedicalEval | 近4万道医学考试真题和近6万份病历 | 3个维度:基础知识、临床应用、安全规范(医疗反事实、毒害伦理、患者知情权等角度) | 查准率、召回率、F1值和Bert score |

| 上海市数字医学创新中心 | MedBench | 30万道中文医疗专业测评题目 | 5个维度:医学语言理解、医学语言生成、医学知识问答、复杂医学推理、医疗安全和伦理 | BLEU、ROUGE-L、F1值 |

| 中文信息学会 | CBLUE | 20万条临床问答网站、医疗对话语料库 | 4个维度:准确性、流畅性、信息完整性、专业性 | 准确率、召回率、F1值、BLEU、信息覆盖率、语义相关性等 |

| 深圳市大数据研究院 | CMB | 30万道中文医疗专业测评题目和74个复杂病例 | 4个维度:流畅性、相关性、完整性、医学知识专业性 | 准确率、相似性及适用性 |

注:F1值为精确率和召回率的调和平均数,用于测量准确度;Bertscore是用于评估文本生成的自动评价指标;BLEU和ROUGE指生成文本与参考文本的相似度,用于评估翻译质量。 |

3 医疗LLM评价具体方法

3.1 运用客观量表进行质量评价

表4 医疗大语言模型质量评估工具 |

| 评估工具 | 评估内容 | 分值范围 |

|---|---|---|

| Likert量表 | 评估响应准确性、信息量和可理解性 | 5种分类等级变量(强烈不同意、不同意、不置可否、同意、强烈同意 |

| Flesch阅读量表 | 评估模型输出文本的可读性,分值越高代表可读性越强 | 0~100分 |

| Flesch-Kincaid分级Coleman-Lia指数 | 理解文本需要的教育水平,或文本复杂性;分值高代表内容复杂 | / |

| DISCERN评分系统 | 评估响应质量、相关性、信息公平性;分值高代表信息质量高,内容表述充分 | 16~80分 |

3.2 根据应用转化能力综合评估

3.3 任务处理导向进行对比测试

表5 医疗大语言模型对比测试的代表性研究 |

| 代表性研究 | 提问内容 | 对照 | 评价指标 |

|---|---|---|---|

| 2024年 Li等[33] | 腹部整形手术问题 | PubMed/Cochrane | 有效性、准确性 |

| 2023年Moskatel等[34] | 47种预防偏头痛药物的效果 | FDA适应证、美国神经病学学会循证指南 | 可靠性、准确性 |

| 2023年Liu等[35] | 50个神经外科领域问题 | 国家卫生健康委指南 | 相关性 |

| 2023年Singhal等[36] | 临床知识问答 | 临床指南或共识、医生人工答案 | 1)一致性;2) 阅读理解、检索和推理能力;3) 不正确或遗漏的内容; 4) 临床危害;5) 医疗人口统计的偏见;6)有用性;7) 解决问题的意图 |

| 2023年Lam Hoai等[37] | 中重度银屑病的药物评价 | meta分析/网状meta分析 | 内容重复性、可接受性、相似性及适用性 |

| 2024年Liu等[38] | 患者咨询问诊 | 初级保健医生人工答案 | 准确性、有用性、同理心、响应能力 |

| 2023年Singhal等[36] | 临床知识问答 | 临床指南或共识、医生人工答案 | 1)一致性;2) 阅读理解、检索和推理能力;3) 不正确或遗漏的内容; 4) 临床危害;5) 医疗人口统计的偏见;6)有用性;7) 解决问题的意图 |